現代のデジタル社会において、私たちは意識することなく多種多様な文字情報を扱っています。

インターネット上のウェブサイト、電子メール、スマートフォンのアプリなど、あらゆる場所で文字がスムーズに表示されるのは、ある技術が背景にあるからです。

その技術の中心にあるのが「Unicode」と「UTF-8」ですが、この二つの言葉がどのように異なり、どのような関係性を持っているのか、疑問に感じる方も多いのではないでしょうか。

この記事では、UnicodeとUTF-8の基本的な違いから、なぜこれらが現代のコンピューターシステムにおいて不可欠な存在となっているのかを、わかりやすく解説していきます。

その複雑な関係性を紐解き、日々のデジタル体験がどのように支えられているのかを理解する手助けとなるでしょう。

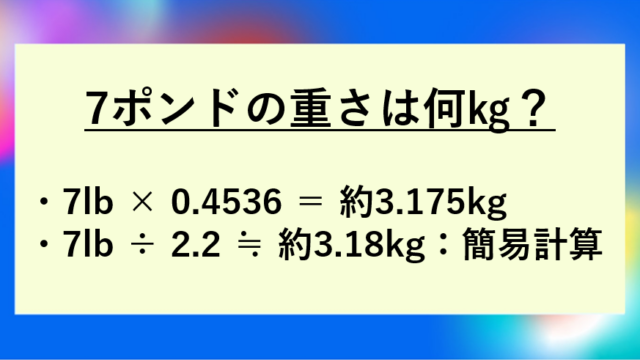

Unicodeは文字の共通辞書、UTF-8はその辞書をデータとして伝える効率的な方法!

それではまず、UnicodeとUTF-8の根本的な違いと関係性について解説していきます。

Unicodeとは「文字集合」を定めるもの

Unicodeとは、世界中のあらゆる文字を統一的に扱うための「文字集合」および「文字コード」の国際標準です。

ひらがな、カタカナ、漢字、アルファベット、数字、記号はもちろん、世界各国の言語の文字一つひとつに、重複しない一意の番号(コードポイント)を割り振っています。

これにより、異なる言語や地域で使われる文字が、特定のシステムや環境に依存せず、常に同じ形で表現されることを目指しています。

例えるなら、世界中の文字を集めた巨大な「共通辞書」のような存在だと言えるでしょう。

UTF-8とは「符号化方式」の一つ

一方、UTF-8は、Unicodeで定義された文字のコードポイントを、実際にコンピューターの内部でどのようにビット列(バイト列)として表現し、保存・伝送するかを定めた「符号化方式」(エンコーディング)の一つです。

Unicodeの文字集合は膨大なので、全ての文字を同じバイト数で表現すると無駄が大きくなってしまいます。

そこでUTF-8では、文字によって必要なバイト数が変わる「可変長エンコーディング」という方式を採用しています。

これにより、英語のアルファベットは1バイト、日本語や中国語の漢字は通常3バイト、それ以上の文字は4バイトで表現されるのが一般的です。

UnicodeとUTF-8の関係性

UnicodeとUTF-8の関係性は、まるで「概念」と「実現方法」のようなものです。

Unicodeが文字そのものと識別番号を定義する「設計図」だとすれば、UTF-8はその設計図に基づいて文字を「実際にデータとして表現する手段」に例えられます。

つまり、Unicodeという共通のルールがあるからこそ、UTF-8のような符号化方式を用いて、世界中の文字を効率的にコンピューターで扱えるようになっているのです。

Unicodeだけでは、コンピューターはどのように文字を読み書きすれば良いか分かりません。

UTF-8のような符号化方式があって初めて、Unicodeの文字がデジタルデータとして意味を持つようになるわけです。

符号化方式の種類とその特徴

続いては、UTF-8以外の主要な符号化方式とその特徴を確認していきます。

UTF-16との違い

UTF-16もまた、Unicodeの文字を符号化する方式の一つです。

UTF-8と同様に可変長エンコーディングですが、文字を表現する際の基本単位が異なります。

UTF-16は、基本的に2バイト(16ビット)を単位として文字を表現します。

ほとんどの文字は2バイトで表現されますが、一部の特殊な文字(サロゲートペア)については4バイトで表現されます。

例えば、基本多言語面(BMP)に含まれる文字(U+0000からU+FFFFまでの文字)は2バイト、それ以外の補助文字面にある文字は4バイトで表現されるのです。

UTF-8がASCII文字を1バイトで表現できるのに対し、UTF-16は全ての文字を最低2バイトで表現するため、欧米圏のテキストではUTF-8の方がデータサイズが小さくなる傾向があります。

UTF-16は、主にWindowsの内部システムやJava言語などで利用されることが多いでしょう。

その他の符号化方式と歴史的背景

UnicodeとUTF-8が普及する以前は、各国や地域ごとに独自の文字コードが使われていました。

例えば日本では、Shift_JIS、EUC-JP、JISなどがあり、それぞれが異なる方法で日本語の文字を表現していました。

これらの文字コードは、自国の言語を扱う上では便利でしたが、異なる文字コードのファイルを開くと「文字化け」が発生するという問題がありました。

これは、ある文字コードで書かれたデータを、別の文字コードで解釈しようとしたために起こる現象です。

世界中で情報のやり取りが増えるにつれて、異なる環境間での文字の互換性を確保できる共通の基盤が必要とされ、その解決策としてUnicodeが広まっていったのです。

各エンコーディングの使い分け

現在、インターネットや新しいシステムにおいては、UTF-8がデファクトスタンダードとなっています。

これは、UTF-8が持つ互換性、効率性、そして国際化への対応能力が高いことによるものです。

古いシステムや特定のアプリケーションでは、未だにShift_JISやEUC-JP、あるいはUTF-16が使われているケースもあります。

データのやり取りを行う際には、送信側と受信側で同じエンコーディングを使用することが非常に重要です。

特にWebサイトや電子メールでは、世界中の多様な言語を扱うためにUTF-8がデファクトスタンダードとなっています。

以下の表で主要な符号化方式を比較してみましょう。

| 符号化方式 | 特徴 | 主な用途 |

|---|---|---|

| UTF-8 | 可変長(1~4バイト)、ASCII互換性あり | Web、Linux、多言語環境全般 |

| UTF-16 | 可変長(2~4バイト)、効率が中 | Windows内部、Java、macOS内部 |

| Shift_JIS | 固定長ではない(1~2バイト)、日本語専用 | 古いWindowsアプリ、携帯電話 |

なぜUTF-8が主流になったのか

次に、なぜUTF-8が現代のデジタル世界でこれほどまでに普及したのか、その理由を見ていきましょう。

互換性と効率性

UTF-8が広く普及した最大の理由の一つは、その高い互換性と効率性にあります。

UTF-8は、特に英語圏で多く使われるASCII文字を1バイトで表現できるため、既存のシステムとの互換性が非常に高く、これが普及の大きな要因の一つとなりました。

ASCIIは128種類の文字を1バイトで表現する最も基本的な文字コードで、UTF-8は最初の128文字をASCIIと全く同じ形式で符号化します。

これにより、英語主体の環境でもデータサイズを無駄に増やすことなく、かつ多言語対応も可能という柔軟性を持ち合わせています。

データ量も、必要最低限のバイト数で文字を表現できるため、ストレージやネットワーク帯域の節約にも貢献しています。

国際化と多様な言語への対応

Unicodeという「共通辞書」を最も効率よく、かつ広範囲にわたって活用できるのがUTF-8です。

世界中のほぼ全ての文字を単一のエンコーディングで扱えるため、異なる言語が混在するウェブページやドキュメントでも、文字化けを心配することなく表示できます。

これにより、グローバルな情報共有が格段に容易になり、多様な言語圏の人々がインターネットを通じてつながれるようになりました。

アプリケーション開発においても、UTF-8を標準とすることで、ローカライズ(地域対応)の手間を大幅に削減できるメリットがあります。

Web標準としての採用

UTF-8の普及を決定づけたのは、ウェブ技術における標準としての採用でしょう。

W3C(World Wide Web Consortium)がWebページの標準エンコーディングとしてUTF-8を推奨し、主要なWebブラウザやサーバーがこれを全面的にサポートしたことで、インターネット上の情報の大部分がUTF-8で表現されるようになりました。

現在では、ウェブサイトの約98%がUTF-8を使用していると言われており、その普及率は圧倒的です。

この標準化により、Web開発者はエンコーディングの違いによる問題を気にすることなく、コンテンツ作成に集中できるようになりました。

以下の表で、主要な文字コードと主な用途の例を示します。

| 文字コード | 主な用途 | 備考 |

|---|---|---|

| UTF-8 | Webページ、電子メール、OS(Linux, macOS)、プログラミング | 現在のデファクトスタンダード |

| UTF-16 | OS(Windows)、特定の開発環境(Java) | 内部処理によく使われる |

| Shift_JIS | 過去の日本のWebサイト、Windowsのレガシーアプリ | 日本語特化型、文字化けの可能性あり |

日常生活でのUTF-8とUnicode

最後に、私たちの日々のデジタル生活におけるUTF-8とUnicodeの役割について考えてみましょう。

Webブラウジングとアプリ利用

私たちがウェブサイトを閲覧したり、SNSで投稿したり、メッセージアプリでやり取りする際、その裏側では常にUTF-8とUnicodeが働いています。

例えば、あなたが日本語で書かれたウェブサイトを閲覧し、同時に英語のニュース記事を読み、友人と韓国語でチャットしているとします。

これら全ての異なる言語が、特別な設定なしにスムーズに表示されるのは、Unicodeがそれらの文字を定義し、UTF-8がそれらをデータとして正確に伝達しているからに他なりません。

これにより、私たちは言語の壁を感じることなく、世界中の情報にアクセスし、コミュニケーションを取ることができるのです。

ファイル保存とデータ交換

コンピューター上でテキストファイルを保存する際にも、エンコーディングは重要な役割を果たします。

多くのテキストエディタでは、ファイルを保存する際にエンコーディング形式を選択するオプションがあります。

例えば、メモ帳でテキストファイルを保存する際に「エンコーディング」の項目で「UTF-8」を選択する機会があるかもしれません。

プログラミングのソースコードも、通常はUTF-8で保存されます。

これは、開発チームのメンバーが異なる国にいたり、異なるOSを使っていたりしても、同じコードを正しく共有し、実行できるようにするためです。

CSVファイルなどのデータファイルを交換する際にも、どのエンコーディングで保存されているかが重要になり、互換性確保のためにUTF-8が推奨されることが多いでしょう。

文字化けが起きたら

もし、テキストファイルやWebページで「文字化け」が発生してしまった場合、それは送り手と受け手で異なる文字コードの解釈をしているために起こる現象です。

例えば、Shift_JISで保存されたファイルをUTF-8として開こうとすると、正しく表示されず意味不明な記号の羅列になってしまいます。

このような時には、使用しているアプリケーションやブラウザのエンコーディング設定を確認し、適切なエンコーディング(多くの場合、UTF-8を試してみるのが良いでしょう)に切り替えることで解決することがほとんどです。

文字コードの知識は、デジタルデータのトラブルシューティングにおいても非常に役立つでしょう。

まとめ

この記事では、UnicodeとUTF-8の違いと関係性について詳しく解説しました。

Unicodeは世界中の文字を統一的に扱うための「文字集合」であり、文字一つひとつに一意の番号を割り振る役割を持っています。

一方、UTF-8は、そのUnicodeで定義された文字をコンピューターで実際に扱うための「符号化方式」の一つです。

特にWebの世界で主流となっているUTF-8は、ASCII文字との互換性や効率性、そして多様な言語への対応能力の高さから、現代のデジタルコミュニケーションに不可欠な存在となっています。

これらの技術が裏で機能しているからこそ、私たちは世界中の情報をスムーズに共有し、言語の壁を越えたコミュニケーションを実現できているのです。

今後、文字コードに遭遇した際には、UnicodeとUTF-8が私たちのデジタル生活を支える重要な基盤であることを思い出していただければ幸いです。